背景与挑战

模型合并是一种强大的技术,通过结合任务特定模型的权重,创建多功能的多任务模型。这种方法能够实现技能积累、模型弱点修补和现有模型的协同改进等关键能力。尽管模型合并在全秩微调(FFT)模型中取得了显著成功,但在应用于参数高效微调(PEFT)方法,特别是低秩适应(LoRA)时,遇到了重大挑战。

- 对齐度问题:通过中心核对齐(CKA)分析发现,与任务更新对齐度高的FFT模型不同,LoRA模型的对齐度较低,表明其任务更新过程通过未对齐的子空间处理输入。

- 现有方法的局限性:现有的模型合并方法,如任务算术(TA)、TIES和DARE,虽然在FFT模型中表现出色,但在LoRA模型中由于模型间权重纠缠增加而显示出有限的成功。

KnOTS:通过SVD的知识导向

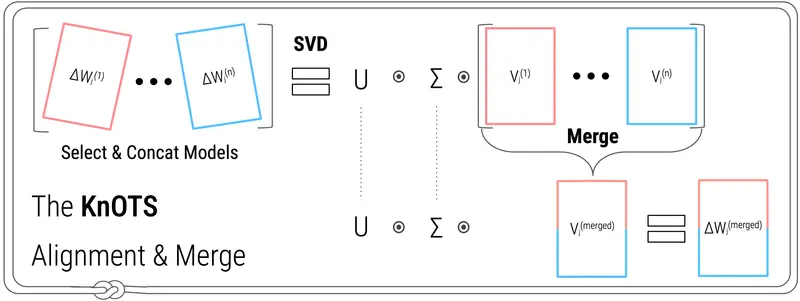

为了解决这些挑战,来自乔治亚理工学院、IBM研究院和麻省理工学院的研究人员提出了 KnOTS(通过SVD的知识导向),这是一种新颖的方法,使用奇异值分解(SVD)将不同LoRA模型的任务更新转换为共享空间。该方法设计为多功能且与现有合并技术兼容。

技术细节

- SVD分解:

- 任务更新转换:KnOTS 通过结合每层的任务更新并通过SVD分解它们,将不同LoRA模型的任务更新转换为共享空间。

- 共享表示空间:SVD分解将任务更新投影到一个共享的低维子空间中,从而实现更好的对齐和合并。

- 多阶段架构:

- 对齐和合并:KnOTS 实现了一个复杂的多阶段架构,以有效对齐和合并LoRA模型。

- 兼容性:该方法与几种现有的无梯度合并方法兼容,包括RegMean、任务算术(TA)、TIES和DARE。

新基准:联合评估

研究人员引入了一个新的“联合评估”基准,用于评估合并模型处理来自多个数据集的输入的能力,而无需特定于数据集的上下文。该基准提供了对模型在不同任务中泛化能力的更现实评估。

实验结果

实验结果展示了KnOTS在各种模型架构和任务中的有效性:

- 视觉领域:

- ViT-B/32模型:当合并八个在不同图像分类数据集上微调的ViT-B/32模型时,KnOTS与现有方法相比表现相似。

- ViT-L/14模型:在更大的ViT-L/14模型上,KnOTS-TIES的表现优于基线方法高达3%。

- 语言领域:

- Llama3-8B模型:在用于自然语言推理任务的Llama3-8B模型上测试时,KnOTS-TIES显著改善了基线方法,平均归一化准确率提高了2.9%。

- KnOTS-DARE-TIES:进一步将性能提高了0.2%。

结论

在这篇论文中,研究人员介绍了KnOTS,一种利用奇异值分解(SVD)将LoRA模型的任务更新转换为共享表示空间的方法,从而能够应用各种无梯度合并技术。KnOTS 方法在不同模型架构和任务中展示了其有效性,持续将现有合并方法的性能提高了高达4.3%,展示了其在不同模型架构和任务中的鲁棒性。

KnOTS 有潜力通过有效对齐和合并LoRA表示来创建通用、多任务模型,为未来的AI应用提供了新的方向。通过解决LoRA模型合并的挑战,KnOTS 为参数高效微调方法的广泛应用铺平了道路,使得更多研究人员和开发者能够利用这些技术来构建更强大、更灵活的多任务模型。