近年来,大语言模型(LLMs)已成为人工智能的基石,推动了聊天机器人、虚拟助手和各种复杂应用的发展。尽管取得了显著成功,但一个显著的问题已经出现:历史上推动模型进步的规模法则已经趋于平稳。简而言之,构建更大的模型不再像以前那样带来显著的性能提升。此外,这些庞大的模型训练和维护成本高昂,造成了可访问性和可用性方面的挑战。这种平稳状态促使人们将重点转向有针对性的训练后方法,以增强和专门化模型能力,而不仅仅依赖于模型的大小。

介绍 Athene-V2:LLM 开发的新方法

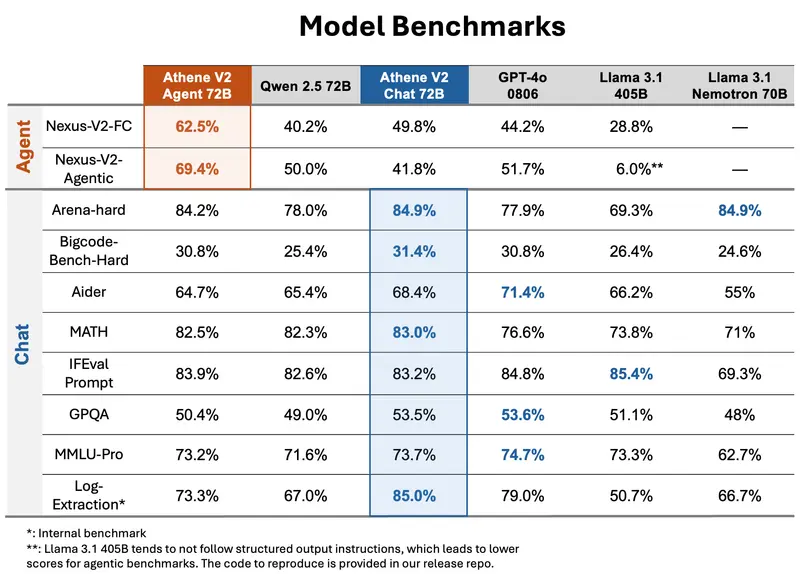

Nexusflow 推出了 Athene-V2:一个开放的720亿参数模型套件,旨在应对AI开发中的这一转变。Athene-V2 在各种基准测试中与 OpenAI 的 GPT-4o 相当,提供了一种专门化、前沿的方法来解决现实世界的问题。该套件包括两个独特的模型:Athene-V2-Chat 和 Athene-V2-Agent,每个模型都针对特定能力进行了优化。Athene-V2 的引入旨在通过专注于训练后的定制功能来突破当前的限制,使 LLMs 在实际应用中更加高效和可用。

技术细节和优势

Athene-V2-Chat

- 用途:通用对话用途,包括基于聊天的应用、编码辅助和数学问题解决。

- 性能:在这些基准测试中直接与 GPT-4o 竞争,证明了其在日常使用案例中的多功能性和可靠性。

- 训练数据:包括用于自然语言理解、编程语言和数学逻辑的大量数据集。

- 优势:特别擅长处理对话的复杂性、编码查询和解决数学问题。

Athene-V2-Agent

- 用途:专注于代理特定的功能,在函数调用和面向代理的应用中表现出色。

- 性能:在特定的基于代理的操作中超过了 GPT-4o。

- 训练数据:针对涉及 API 函数调用和决策工作流的场景进行了优化。

- 优势:在复杂函数调用任务中表现出更强的能力。

技术细节

- 参数规模:720亿参数,保持在可管理的范围内,相比一些更大、计算密集型的模型,仍然提供与 GPT-4o 相当的性能。

- 训练后处理:基于 Qwen 2.5 构建,并经过了严格的训练后处理,以放大各自的优势。

- 适应性和成本效益:通过有针对性的训练后处理,使模型更具适应性和成本效益,而不会牺牲性能。

重要性和应用

重要性

- 创新方法:随着规模法则达到平稳状态,LLMs 的创新需要一种不同的方法——一种专注于增强专门化能力而非仅增加大小的方法。

- 基准测试结果:Athene-V2-Chat 和 Athene-V2-Agent 在现有开放模型上显示出显著的改进,分别在自然语言理解、代码生成和数学推理方面与 GPT-4o 相当,而在复杂函数调用任务中表现出更强的能力。

应用

- 教育:学生可以通过与 Athene-V2-Chat 互动来学习编程和数学。

- 商业:客户服务培训可以涉及处理各种个性,提高员工应对复杂客户情况的能力。

- 游戏开发:游戏中可以创建复杂的不可玩角色(NPC),使游戏世界更加丰富和真实。

- 社会学和经济学:研究者可以虚拟运行复杂的社交实验,研究群体动态和经济行为。

结论

总之,Nexusflow 的 Athene-V2 代表了大语言模型演变中的重要一步。通过强调有针对性的训练后处理和专注于专门化能力,Athene-V2 提供了一个强大、适应性强的替代方案,以替代更大、更笨重的模型,如 GPT-4o。Athene-V2-Chat 和 Athene-V2-Agent 能够在各种基准测试中以如此精简的架构竞争,证明了AI开发中专业化的力量。随着我们进入后规模法则时代,Nexusflow 的 Athene-V2 等方法可能会定义下一波进步,使AI更加高效、可访问,并针对特定用例进行定制。