浙江大学和阿里巴巴通义实验室的研究人员推出机器写作框架OmniThink,旨在通过模拟人类的迭代扩展和反思过程来突破大型语言模型在机器写作中的知识边界。该框架通过不断深化对主题的理解,扩展知识边界,生成信息丰富、深度和实用性更强的文章。

- 项目主页:https://zjunlp.github.io/project/OmniThink

- GitHub:https://github.com/zjunlp/OmniThink

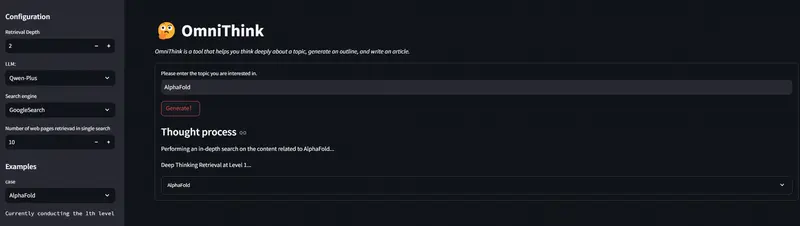

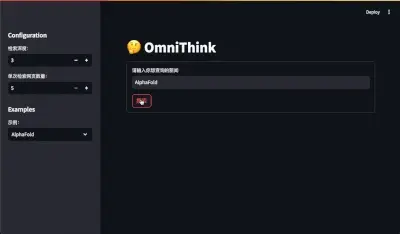

- Demo:https://www.modelscope.cn/studios/iic/OmniThink

例如,在生成关于“AlphaFold”的文章时,传统的机器写作方法可能会重复提及“AlphaFold是由DeepMind开发的”这一信息,而OmniThink能够通过迭代扩展和反思,深入挖掘AlphaFold在蛋白质结构预测、生物医学研究影响、未来应用方向等多个方面的详细信息,生成更全面、深入的文章。

主要功能

- 知识边界扩展:通过模拟人类学习者逐步深化对主题理解的认知行为,OmniThink能够超越预定义范围,生成具有丰富信息的内容。

- 信息深度与实用性提升:解决传统方法中检索信息缺乏深度和实用性的问题,避免生成浅薄、重复和缺乏原创性的文章。

- 高质量长篇文章生成:在保持连贯性和深度等关键指标的同时,提高文章的知识密度,生成有根据、高质量的长文档。

主要特点

- 迭代扩展与反思机制:核心思想是模拟人类的迭代扩展和反思过程,通过不断反思已检索信息,确定进一步扩展的最佳步骤,动态调整检索策略,更全面地探索相关信息。

- 信息树与概念池构建:在信息获取阶段,构建信息树和概念池,为后续的大纲构建和文章生成奠定基础,使文章生成更具结构化和信息丰富性。

- 模型无关性:该框架不依赖于特定的模型,可以与现有的框架集成,具有较好的通用性和扩展性。

工作原理

- 信息获取:基于输入主题,利用搜索引擎检索相关信息,构建初始的信息树根节点和概念池。然后通过迭代的扩展和反思过程,逐步深化对主题的理解,丰富信息树和概念池。

- 扩展:分析信息树的所有叶节点,确定需要进一步扩展的节点,生成子节点并检索相关信息,更新信息树。

- 反思:对新检索的信息进行分析、过滤和综合,提炼核心见解并更新概念池,为下一步扩展提供指导。

- 大纲构建:基于概念池,创建初步大纲草稿,并进一步精细化,形成最终的大纲,确保文章内容的方向、结构层次和逻辑连贯性。

- 文章撰写:根据构建好的大纲,为每个部分撰写内容。利用各部分的标题和层次结构,从信息树中检索最相关的文档,生成带有引用的节内容。最后将各节内容串联起来,去除冗余信息,形成最终文章。

具体应用场景

- 长篇文章生成:适用于需要生成高质量、长篇幅文章的场景,如学术论文、报告、综述文章等,能够提供更深入、全面的内容。

- 知识密集型内容创作:在需要涵盖大量知识和信息的写作任务中,如科技领域的文章、行业分析报告等,OmniThink能够通过扩展知识边界,生成更具深度和实用性的内容。

- 教育领域:可用于生成教育相关的教材、课程大纲、学习指南等,帮助学生更好地理解和掌握知识,提供更丰富的学习资源。