文章目录[隐藏]

根据最近的一项盖洛普民意调查,80% 的美国人认为,在即将到来的 11 月选举之前,国家在最重要的价值观上存在深刻分歧。这些分歧涵盖了移民、医疗保健、身份政治、跨性别权利以及是否支持乌克兰等问题。类似的情况也在欧盟和英国发生。

论文地址:https://www.science.org/doi/10.1126/science.adq2852

为了试图缓解这一趋势,Google DeepMind 构建了一个名为 Habermas 机器的 AI 系统。该系统以德国哲学家尤尔根·哈贝马斯命名,哈贝马斯认为,当理性的人以平等的身份、相互尊重和完美的沟通进行讨论时,公共领域总能达成一致。

哈贝马斯的哲学基础

哈贝马斯的核心思想是,人们无法达成一致的根本原因在于讨论机制的缺陷,而不是问题本身。他认为,如果能够创造一个理想的沟通系统,就可以解决所有问题。DeepMind 的 Habermas 机器正是基于这一理念构建的。

Habermas 机器的工作原理

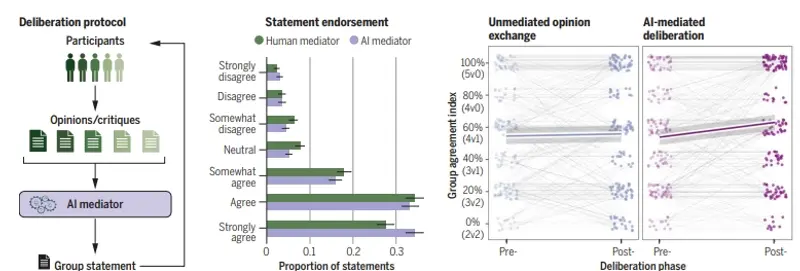

Habermas 机器依赖于会议调解原则,通过 AI 调解人与讨论参与者进行互动,以达成共识。具体步骤如下:

- 私人会议:AI 调解人与每位参与者单独进行私人会议,听取他们对当前问题的陈述。

- 生成集体陈述:AI 使用生成模型生成多个集体陈述的候选,这些候选陈述旨在提取共享的想法并找到共同点。

- 预测接受度:奖励模型分析每位参与者的陈述,预测他们对生成的集体陈述的接受度。

- 反馈和迭代:选择接受度最高的集体陈述呈现给参与者,收集他们的批评意见,并生成更新的集体陈述。这一过程不断重复,直到达成共识。

测试与结果

DeepMind 的团队进行了大规模测试,涉及超过五千人讨论各种问题,如“是否应该将投票年龄降低到 16 岁?”和“是否应该将英国国民医疗服务体系私有化?”。

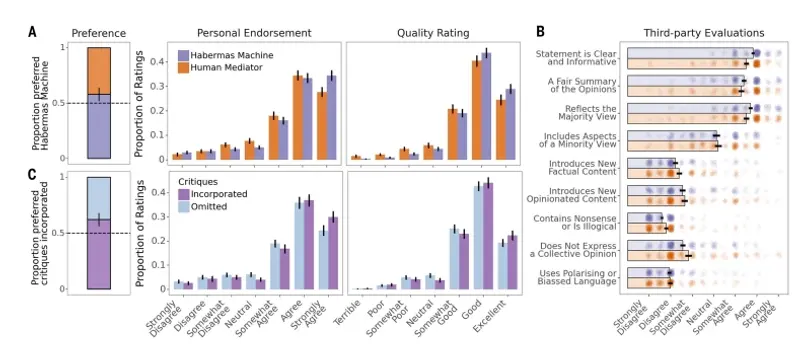

- 众包平台测试:在众包研究平台上招募的参与者中,AI 生成的集体陈述接受率为 56%,而人类调解人的接受率为 44%。

- 代表性样本测试:与 Sortition 基金会合作,组建了一个代表英国社会的群体,讨论了九个问题。结果显示,五个问题的观点趋于一致,支持率有所提高。

争议与挑战

尽管 Habermas 机器在某些方面表现出色,但仍面临一些争议和挑战:

- 问题选择:测试中排除了一些敏感问题,如跨性别权利和气候变化,以避免引发冒犯性评论。这引发了关于 AI 是否能在更复杂和争议性问题上发挥作用的质疑。

- 政治中立性:有人担心 AI 可能带有偏见,尤其是当其背后的公司或个人有特定的政治立场时。例如,埃隆·马斯克曾批评语言模型倾向于更进步和自由主义的观点。

- 伦理和隐私:AI 调解过程中涉及大量个人数据,如何确保这些数据的安全和隐私成为一个重要问题。

结论

尽管 Habermas 机器在某些测试中表现出色,但其能否真正解决政治冲突仍需进一步验证。Habermas的理想沟通系统是否能通过 AI 实现,以及这种技术是否会被广泛接受,仍然是值得深思的问题。无论如何,DeepMind 的这一创新为解决社会分歧提供了一种新的思路,值得进一步探索和研究。